CEO OpenAI Сем Альтман / Depositphotos

Розробник ChatGPT у коментарі Financial Times заявив, що має докази того, що китайська DeepSeek використала дані OpenAI для навчання конкурентної моделі штучного інтелекту.

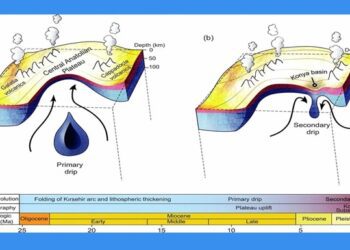

Йдеться про присутність ознак «дистиляції» — техніки, яку розробники застосовують для підвищення ефективності менших моделей шляхом використання результатів більших і потужніших версій. Дистиляція є звичною практикою для галузі, утім, зважаючи на те, що DeepSeek могла використати її для створення конкурентки, це порушує умови обслуговування OpenAI.

«Проблема у тому, що модель створена для власних цілей», — сказала у коментарі виданню людина, близька до OpenAI.

В умовах обслуговування OpenAI зазначено, що користувачі не можуть «копіювати» будь-який з сервісів компанії або «використовувати результати для розробки моделей, які конкурують з OpenAI».

Випуск останньої моделі міркування DeepSeek сколихнув ринок штучного інтелекту, обваливши акції ключових компаній у галузі. Лише Nvidia зазнала падіння на понад 17% і втратила майже $600 млрд за день — у вівторок ситуація дещо стабілізувалась і акції компанії наростили 9%.

Повідомляється, що OpenAI разом зі своїм ключовим партнером Microsoft «дослідили акаунти, які ймовірно належали DeepSeek і використовувались минулої осені, та заблокували їх за підозрою у дистиляції».

Раніше підприємець Девід Сакс, відповідальний за розвиток штучного інтелекту в адміністрації Дональда Трампа, заявив, що «крадіжка даних цілком можлива».

СпецпроєктиЧи є користь від ноутбука з двома екранами та чи зручно за ним працювати? Розбираємося на прикладі ASUS Zenbook DUOМікрофони HyperX QuadCast 2 та QuadCast 2S: чистий звук у складних умовах, інноваційна підсвітка та свій застосунок

«У штучному інтелекті є техніка, яка називається дистиляцією …коли одна модель вчиться в іншої моделі й ніби висмоктує знання з материнської моделі», — говорив Сакс у коментарі журналістам. «Є суттєві докази того, що DeepSeek зробила те саме, вилучивши знання з моделей OpenAI, і не думаю, що OpenAI дуже цим задоволена».

Експерти кажуть, що для менших китайських та американських лабораторій ШІ крадіжка навчальних даних у таких компаній, як OpenAI, є звичною справою — оскільки повноцінний процес навчання потребує чимало вливань. Нагадаємо, що DeepSeek заявляла, що використала кластер з 2000 відеокарт Nvidia H800 і загалом $5,6 млн на навчання моделі V3 з 671 млрд параметрів — тоді як навчання лише GPT-4 обійшлось у $100 млн. При цьому підозри у крадіжці даних з’явились ще на момент запуску китайської моделі, коли та сама стверджувала, що «вона і є ChatGPT».

«Ми знаємо, що китайські компанії — та інші — постійно намагаються скопіювати моделі провідних американських компаній зі штучного інтелекту», — пише OpenAI у своїй останній заяві. «Ми вживаємо контрзаходів, щоб захистити нашу інтелектуальну власність».

Наразі OpenAI й сама бореться зі звинуваченнями щодо порушень авторських прав з боку видань і творців контенту — включаючи позов від The New York Times, який стверджує, що компанія Сема Альтмана без дозволу тренує свої моделі на їхніх статтях.