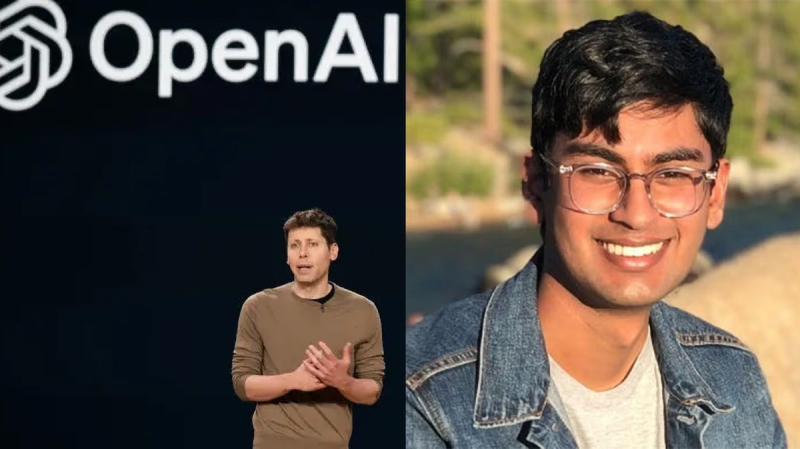

Голова OpenAI Сем Альтман та Сучір Баладжи / YouTube, Instagram

Один з творців ChatGPT, Сучір Баладжі, який викривав проблеми OpenAI та штучного інтелекту, знайдений мертвим у своїй квартирі.

Раптова смерть Сучіра Баладжі шокувала світ технологій та відбулася на тлі бурхливих дискусій щодо штучного інтелекту і законів про авторське право. За кілька місяців до смерті Баладжі викривав глибокі етичні та юридичні проблеми продуктів ШІ. Зокрема, він критикував те, як OpenAI та інші компанії збирають величезні обсяги даних з інтернету для навчання своїх моделей. Баладжі ставив під сумнів законність та етичність цих практик відповідно до чинних норм про авторське право.

Сучір Баладжі був одним із ключових архітекторів ChatGPT. Трагічна смерть 26-річного чоловіка, колишнього члена команди OpenAI та відкритого критика практик компанії, сталася у його квартирі в Сан-Франциско 26 листопада. Поліція підтвердила самогубство, наразі немає доказів зловмисного втручання.

Після чотирьох років роботи в OpenAI Сучір Баладж покинув компанію у серпні 2024 року, посилаючись на занепокоєння щодо використання захищених авторським правом даних без належної згоди. У жовтні він розповів про це в інтерв’ю The New York Times, до якої інженер звернувся сам. У інтерв’ю він пояснював, як системи, подібні до GPT-4, навчаються, створюючи повні копії даних. Свої занепокоєння Баладжі детально описав в есе, де сформулював складність процесів навчання ШІ.

«Хоча генеративні моделі рідко дають вихідні дані, суттєво подібні до будь-якого з їхніх навчальних даних, процес навчання генеративної моделі передбачає створення копій вмісту, захищеного авторським правом … Якщо ці копії несанкціоновані, це потенційно може вважатися порушенням авторських прав, залежно від того, чи кваліфікується конкретне використання моделі як «добросовісне використання». Оскільки добросовісне використання визначається в кожному конкретному випадку, неможливо зробити широке твердження про те, коли саме генеративний ШІ відповідає вимогам добросовісного використання. … Вихідні дані не є точними копіями вхідних даних, але вони також не є принципово новими», — зокрема розповів Баладжі.

Після звільнення Баладжі продовжував активно обговорювати питання, пов’язані з етичністю та законністю дій OpenAI. Лише за день до смерті його ім’я «засвітилося» в судовому позові щодо авторських прав, поданому проти компанії. Іншою проблемою, про яку дискутував Баладжі — генерація неправдивої або повністю вигаданої інформації, яку називають «галюцинаціями». Інтернет, за його словами, змінюється на гірше.

Про свої занепокоєння Баладжі розповів у своїй останній публікації в X Twitter у жовтні та публікації в блозі в тому ж місяці. Він закликав дослідників машинного навчання дізнатися більше про норми авторського права.

СпецпроєктиЧи варто починати накопичувати на пенсію у 30? Розповідаємо, що таке недержавні пенсійні фондиЯк штучний інтелект змінює робочі рутини: огляд ноутбуків MSI для творчих і бізнес-завдань

«Спочатку я не знав багато про авторське право, добросовісне використання тощо, але мені стало цікаво, коли я побачив усі позови, подані проти компаній GenAI. Коли я намагався краще зрозуміти проблему, то врешті-решт дійшов висновку, що добросовісне використання здається досить неправдоподібним захистом для багатьох генеративних продуктів ШІ з тієї основної причини, що вони можуть створювати замінники, які конкурують з даними, на яких вони навчаються».

Він зазначав, що відомі прецеденти, такі як справа Google Books, суперечать твердженню компаній генеративного ШІ про «добросовісне використання». Баладжі уточнював, що його думки спрямовані на ширшу область застосування генеративного ШІ, а не лише проти OpenAI.